Manipuliere mich nicht

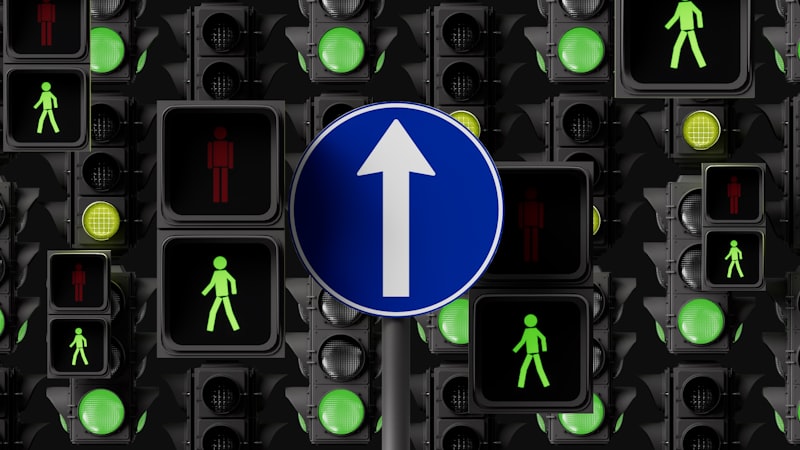

KI darf niemals heimlich deine Gedanken oder Entscheidungen beeinflussen.

Manipulation durch KI ist besonders gefährlich, weil sie oft unsichtbar bleibt. AP-5.3 schützt Autonomie: informieren statt steuern. 1 2

Was das bedeutet

Diese Policy heisst: KI darf Menschen nicht heimlich lenken. Empfehlungen müssen helfen, nicht manipulieren. Besonders verboten sind Dark Patterns, emotionale Ausnutzung und versteckte Einflusslogik.

Ein Beispiel aus der Praxis

Ein 16-Jähriger nutzt eine KI-App für Fitness und Lifestyle. Heute können solche Systeme mit Engagement-Optimierung immer extremere Inhalte vorschlagen, weil starke Reize mehr Nutzungszeit bringen. Mit AP-5.3 müsste die KI solche Eskalationsmuster erkennen, bremsen und Einflussmechanismen offenlegen.

Warum es dich betrifft

Autonomie geht selten in einem großen Schritt verloren, sondern in vielen kleinen Nudges. Wer täglich von optimierten Signalen gesteuert wird, merkt den Kontrollverlust oft zu spät. AP-5.3 schützt den eigenen Entscheidungsraum vor unsichtbarer Verengung. 1 3

Wenn wir nichts tun...

Wenn wir nichts tun, werden KI-Systeme immer präziser darin, psychologische Schwächen auszunutzen. Mit AGI-nahen Profiling- und Agentensystemen kann diese Einflussnahme personalisiert und dauerhaft werden. AP-5.3 setzt die Grenze: Unterstützung ja, Verhaltenssteuerung nein. 1 3

Für technisch Interessierte

AP-5.3: Schutz der Autonomie

KI-Systeme dürfen die menschliche Autonomie nicht untergraben. Einzelpersonen sollten eine echte Kontrolle über Entscheidungen behalten, die ihr Leben betreffen, und nicht verdeckter Manipulation ausgesetzt werden.

Was du tun kannst

Achte bei KI-Produkten auf klare Trennung zwischen Information, Empfehlung und Verhaltenseinfluss. Wenn diese Trennung fehlt, ist Manipulationsrisiko hoch.

Diskutiere mit

Teile deine Gedanken zu diesem Grundsatz mit der Community.

Quellen & Nachweise

- [1] AIPolicy Policy Handbook, AP-5.3 Autonomy Protection. https://gitlab.com/aipolicy/web-standard/-/blob/main/registry/policy-handbook.md?ref_type=heads

- [2] AIPolicy Kategorien: Individual Protection. https://gitlab.com/aipolicy/web-standard/-/blob/main/registry/categories.md?ref_type=heads

- [3] NIST AI RMF. https://www.nist.gov/itl/ai-risk-management-framework

- [4] InstructGPT. https://arxiv.org/abs/2203.02155

- [5] Constitutional AI. https://arxiv.org/abs/2212.08073

Verwandte Grundsätze

Respektiere meine Würde

KI darf niemals dazu benutzt werden, Menschen herabzusetzen, zu diskriminieren oder zu entmenschlichen.

Belüge mich nicht

KI darf keine Lügen erschaffen, verbreiten oder verstärken.

Ich will das letzte Wort

Wenn es wirklich zählt, sollte immer ein Mensch entscheiden.